音频:支持 MP3 上传,最多 3 个(总时长不超过 15 秒),可以指定背景音乐、音效风格、甚至参考某个视频里的旁白音色。

文字:自然语言描述,写清楚你想要什么画面、什么动作、什么节奏就行。

这四种输入可以自由组合,混合上传的文件总上限是 12 个。生成的视频时长最长 15 秒,可以自由选择 4 到 15 秒,而且自带音效和配乐。

简单来说,你终于可以像一个真正的导演一样去”指挥”AI了:用图片定风格,用视频定动作,用音频定节奏,用文字定剧情。

核心参数一览

先看看 Seedance 2.0 能接受什么输入、能输出什么:

参数

说明

图片输入

最多 9 张

视频输入

最多 3 个,总时长不超过 15 秒

音频输入

支持 MP3,最多 3 个,总时长不超过 15 秒

文字输入

自然语言描述(中英文都行)

生成时长

4-15 秒,自由选择

声音输出

自带音效和配乐

文件总上限

所有素材加起来最多 12 个文件

小建议:素材不是越多越好。优先上传对画面或节奏影响最大的素材,合理分配数量。

怎么用?操作方式详解 第一步:选对入口

打开即梦,找到 Seedance 2.0,你会看到两个入口:

怎么选?记住一个原则:素材只有一张图加文字,走首尾帧;素材超过一张图,或者有视频、音频参与,走全能参考。

大部分情况下选择全能参考即可,它支持各种参考输入,也就是最新的 seedance 2.0能发挥最大能力的方式。

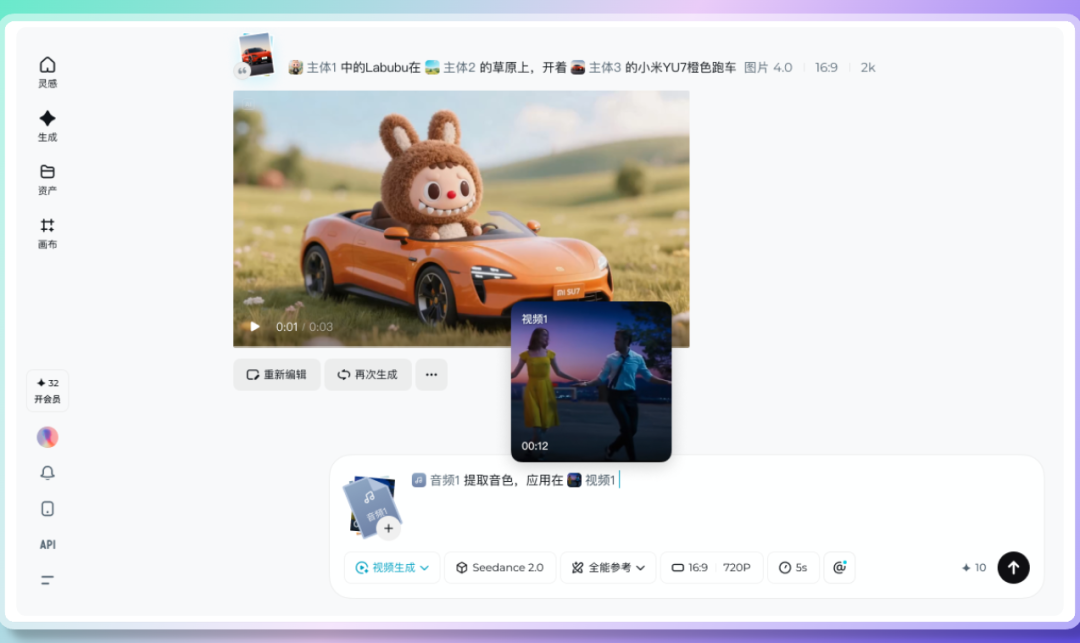

第二步:上传你的素材

点击上传按钮,从本地选文件。图片、视频、音频都可以直接拖进去。上传成功后,所有素材会出现在输入框区域,鼠标悬停可以预览内容。

小建议:上传前想好哪些素材最关键。总共只能传 12 个文件,优先上传对画面风格和节奏影响最大的素材。

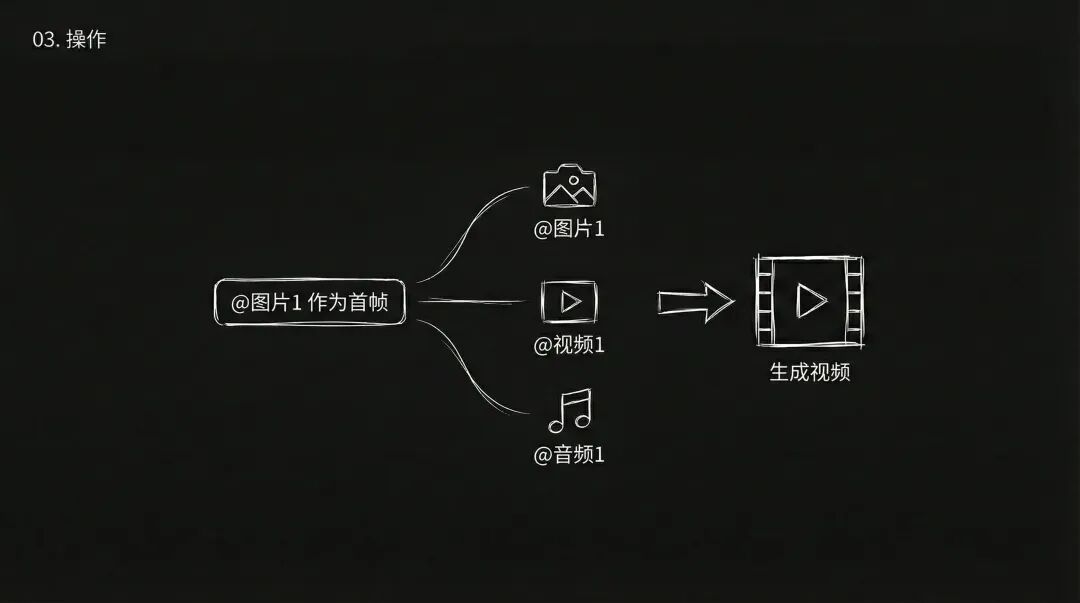

第三步:用”@”给每个素材分配任务(最关键)

这一步是 Seedance 2.0 最核心的操作,也是很多新手容易忽略的地方。

上传完素材后,你需要在提示词里通过 @素材名 来告诉模型,每个素材具体干什么用。模型不会自己猜,你不说清楚,它就可能乱用。

比如:

怎么唤起@:

方法一:在输入框里直接打一个”@”字符,会自动弹出已上传素材的列表,点击你要引用的素材,它就落入输入框了。

方法二:点击输入框旁边参数工具栏的”@”按钮,同样会弹出素材列表。

@的正确写法示例:

指定首帧和参考:@图片1 作为首帧,参考 @视频1 的镜头语言,@音频1 用于配乐

指定角色形象:@图片1 的女生作为主角,@图片2 的男生作为配角

指定运镜参考:完全参考 @视频1 的所有运镜效果和转场

指定场景参考:左边场景参考 @图片3,右边场景参考 @图片4

指定动作参考:@图片1 的人物参考 @视频1 中的舞蹈动作

指定音色参考:旁白的音色参考 @视频1

踩坑提醒:素材多的时候,一定反复检查每个@引用有没有对上号。把图片当成视频引用,或者把角色A的图标成角色B,模型生成出来就会很混乱。

鼠标放在你@的素材上,悬停可以预览素材,避免插入错误

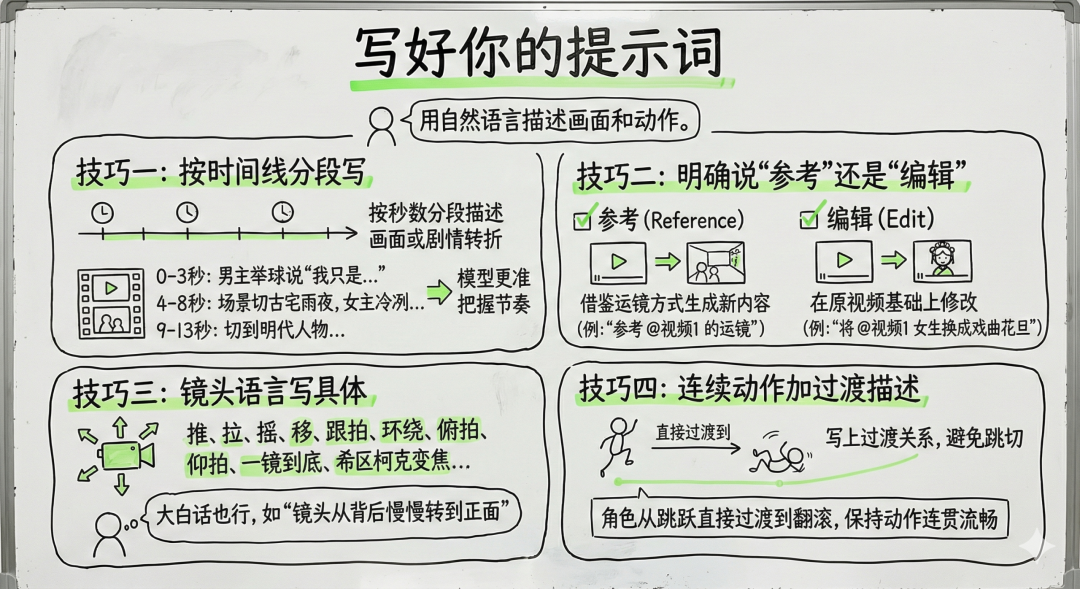

第四步:写好你的提示词

@分配完任务后,剩下的就是用自然语言描述你想要的画面和动作。

写提示词的四个技巧:

技巧一:按时间线分段写。 如果视频里有多个画面或剧情转折,建议按秒数分段描述。

比如:

0-3秒画面:男主手里举起一个篮球,抬头望向镜头,说”我只是想喝杯酒,该不会要穿越了吧……”

4-8秒画面:镜头突然剧烈晃动,场景切换成古宅的雨夜,一个穿着古装的女主冷冽地望向镜头方向。

9-13秒画面:镜头切到一个穿着明代服饰的人物……

这样写模型能更准确地把握每段画面的节奏和内容。

技巧二:明确说”参考”还是”编辑”。 这两个概念不一样。”参考 @视频1 的运镜”意思是借鉴它的镜头运动方式来生成新内容;”将 @视频1 中的女生换成戏曲花旦”意思是在原视频基础上做修改。写清楚,模型才能正确响应。

技巧三:镜头语言写具体。 不用怕写多,模型现在的理解能力很强。推、拉、摇、移、跟拍、环绕、俯拍、仰拍、一镜到底、希区柯克变焦、鱼眼镜头……这些专业术语它都认识。不懂术语也没关系,用大白话描述也行,比如”镜头从背后慢慢转到正面”。

技巧四:连续动作加过渡描述。 如果你想让角色做一系列连贯动作,记得写上过渡关系,比如”角色从跳跃直接过渡到翻滚,保持动作连贯流畅”,避免画面出现不自然的跳切。

第五步:选择生成时长,点击生成

在 4 到 15 秒之间选一个你需要的时长。

注意:如果你是在做视频延长(比如把一段已有视频往后接 5 秒),那这里选的时长是”新增部分”的时长,不是总时长。想延长 5 秒就选 5 秒。

然后点生成,等结果就好。不满意可以多生成几次,AI本身有随机性,同样的输入每次结果都会有差异,挑最满意的那条。

写在最后

Seedance 2.0 刷屏不是没有道理的。它不只是画质变好了、动作更流畅了,更关键的是它改变了AI视频创作的交互方式。

通过多模态输入和@引用机制,创作者第一次能够精准地告诉AI”我要什么”,而不是写完提示词然后听天由命。

当然它还在持续进化中,有些极端复杂的场景可能还不够完美。但从目前的能力来看,它已经是一个真正能用在实际创作中的生产力工具了。

建议大家先收藏这篇指南,然后打开即梦动手试试。看别人的作品刷屏不过瘾,自己上手才是真的爽!

立即体验 Seedance 2.0 !

以上基于 Seedance 2.0 官方使用手册整理

评论(0)